Month: November 2016

[Podcast] Grand entretien à Récherche en Cours (avec Paola Tubaro, Radio Aligre FM, 25 nov. 2016)

A l’occasion de la sortie de notre livre Le phénomène ‘pro-ana’. Troubles alimentaires et réseaux sociaux (Presses des Mines, 2016),… read more [Podcast] Grand entretien à Récherche en Cours (avec Paola Tubaro, Radio Aligre FM, 25 nov. 2016)

Bulles de filtres, spirales de silence, algorithmes et politique (NextINpact, 23 nov. 2016)

(Article paru sur NextINpact, 23 novembre 2016) Élection de Trump : influence ou innocence, le rôle de Facebook en questions… read more Bulles de filtres, spirales de silence, algorithmes et politique (NextINpact, 23 nov. 2016)

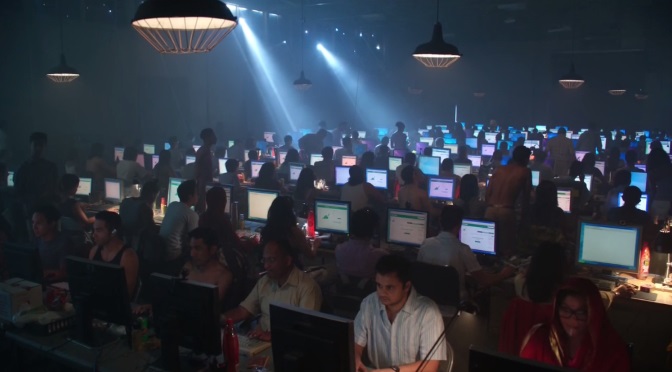

Never mind the algorithms: the role of click farms and exploited digital labor in Trump’s election

The debate over who, in the media and in the IT scene, is responsible for Trump’s victory is just starting. I… read more Never mind the algorithms: the role of click farms and exploited digital labor in Trump’s election

Qui a fait élire Trump ? Pas les algorithmes, mais des millions de “tâcherons du clic” sous-payés

Ce billet a été publié par L’Obs / Rue89 le 19 novembre 2016. Une version en anglais est disponible ici…. read more Qui a fait élire Trump ? Pas les algorithmes, mais des millions de “tâcherons du clic” sous-payés

Entretien : algorithmes et vie privée (Radio Nova, 16 nov. 2016)

Ce matin à 7h15 j’ai pris le premier café de la journée en compagnie d’Edouard Baer et de sa joyeuse… read more Entretien : algorithmes et vie privée (Radio Nova, 16 nov. 2016)

[Slides séminaire #ecnEHESS] Christophe Benavent : Plateformes et gouvernementalité algorithmique (21 nov. 2016, 17h)

Pour la première séance de mon séminaire EHESS Étudier les cultures du numérique : approches théoriques et empiriques nous avons… read more [Slides séminaire #ecnEHESS] Christophe Benavent : Plateformes et gouvernementalité algorithmique (21 nov. 2016, 17h)

![[Note to self] Pourquoi le débat sur Trump et les algorithmes de Facebook est complètement débile](https://www.casilli.fr/wp-content/uploads/2016/11/ToupetParlant_C.jpg)

[Note to self] Pourquoi le débat sur Trump et les algorithmes de Facebook est complètement débile

Cette note à moi-même était destinée à rester dans mon dossier Brouillons. Puis j’ai appuyé sur Publier. Facebook a-t-il facilité… read more [Note to self] Pourquoi le débat sur Trump et les algorithmes de Facebook est complètement débile

Troubles alimentaires et réseaux sociaux: entretien (Radio Télévision Suisse, La 1ère, 5 nov. 2016)

TROUBLES ALIMENTAIRES ET RÉSEAUX SOCIAUX : dérive ou entraide Les défis genre » bikini bridge » ou » A4 waist… read more Troubles alimentaires et réseaux sociaux: entretien (Radio Télévision Suisse, La 1ère, 5 nov. 2016)

![[Podcast] Grand entretien à Récherche en Cours (avec Paola Tubaro, Radio Aligre FM, 25 nov. 2016)](https://www.casilli.fr/wp-content/uploads/2010/09/REC290910.jpg)

![[Slides séminaire #ecnEHESS] Christophe Benavent : Plateformes et gouvernementalité algorithmique (21 nov. 2016, 17h)](https://www.casilli.fr/wp-content/uploads/2016/11/gears-and-86739623.jpg)