Month: February 2017

The business performativity of Mark Zuckerberg’s manifesto

Whenever I hear a businessman talk about building a “healthy society”, my sociologist sense tingles… And although I haven’t been… read more The business performativity of Mark Zuckerberg’s manifesto

![[Vidéo] Intervention au Sénat sur micro-travail, intelligence artificielle et revenu de base (8 févr. 2017)](https://www.casilli.fr/wp-content/uploads/2017/06/Senat_Republique_fr.png)

[Vidéo] Intervention au Sénat sur micro-travail, intelligence artificielle et revenu de base (8 févr. 2017)

J’ai assuré une intervention dans le cadre d’un colloque organisé par le groupe écologiste du Sénat. 1TR_04_REVBA_AntonioCasilli par EcoloSenat

[Séminaire #ecnEHESS] Mark Graham & Karen Gregory “Digital Labor and Global Exploitation” (20 févr. 2017, 17h)

Enseignement ouvert aux auditeurs libres. Pour s’inscrire, merci de renseigner le formulaire. Une séance spéciale, folks ! Dans le cadre… read more [Séminaire #ecnEHESS] Mark Graham & Karen Gregory “Digital Labor and Global Exploitation” (20 févr. 2017, 17h)

Une tribune dans Libération (3 janv. 2016)

Avec Paola Tubaro, je co-signe une tribune dans Libération, à partir de notre ouvrage Le phénomène “pro-ana”, paru aux Presses… read more Une tribune dans Libération (3 janv. 2016)

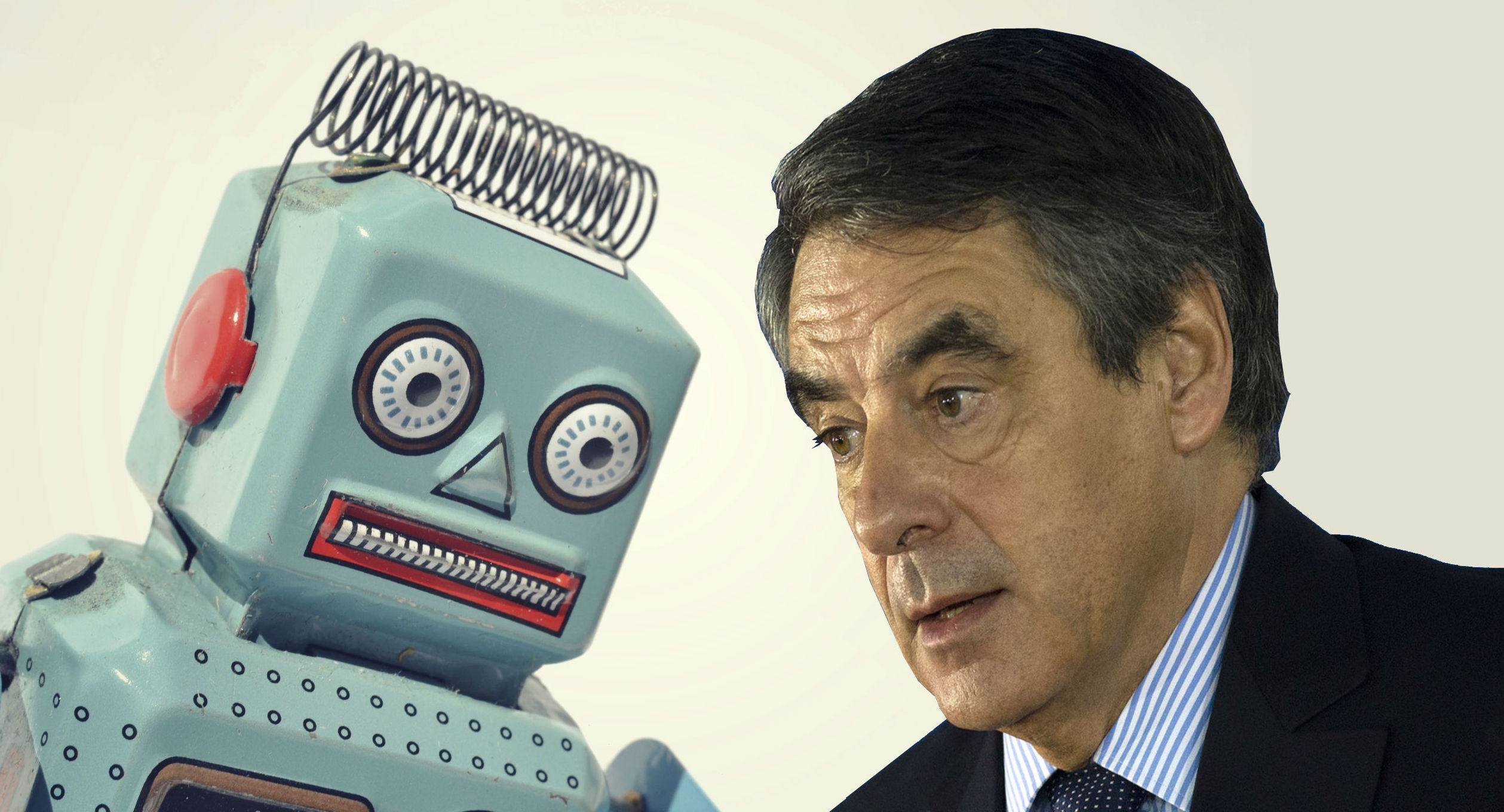

Ni bots, ni e-militants : François Fillon et l’exploitation des travailleurs du clic

Ce billet a été publié dans L’Obs / Rue89 le 3 février 2017. Dans le sillage du PenelopeGate, l’affaire des… read more Ni bots, ni e-militants : François Fillon et l’exploitation des travailleurs du clic

![[Séminaire #ecnEHESS] Mark Graham & Karen Gregory “Digital Labor and Global Exploitation” (20 févr. 2017, 17h)](https://www.casilli.fr/wp-content/uploads/2017/02/sweatshop2.jpg)