Tag: politique

![[Séminaire #ecnEHESS] Gabriella Coleman “Histoire et anthropologie du hacktivisme” (28 mars 2018, 17h)](https://www.casilli.fr/wp-content/uploads/2018/03/coleman.jpg)

[Séminaire #ecnEHESS] Gabriella Coleman “Histoire et anthropologie du hacktivisme” (28 mars 2018, 17h)

Enseignement ouvert aux auditeurs libres. Pour s’inscrire, merci de renseigner le formulaire. C’est avec grand plaisir que notre séminaire Étudier… read more [Séminaire #ecnEHESS] Gabriella Coleman “Histoire et anthropologie du hacktivisme” (28 mars 2018, 17h)

Nommé “ministre d’internet” ??? (Usbek&Rica, 12 mai 2017)

La rédaction du magazine d’innovation et société Usbek & Rica s’est amusé à concocter un gouvernement de personnalités que le… read more Nommé “ministre d’internet” ??? (Usbek&Rica, 12 mai 2017)

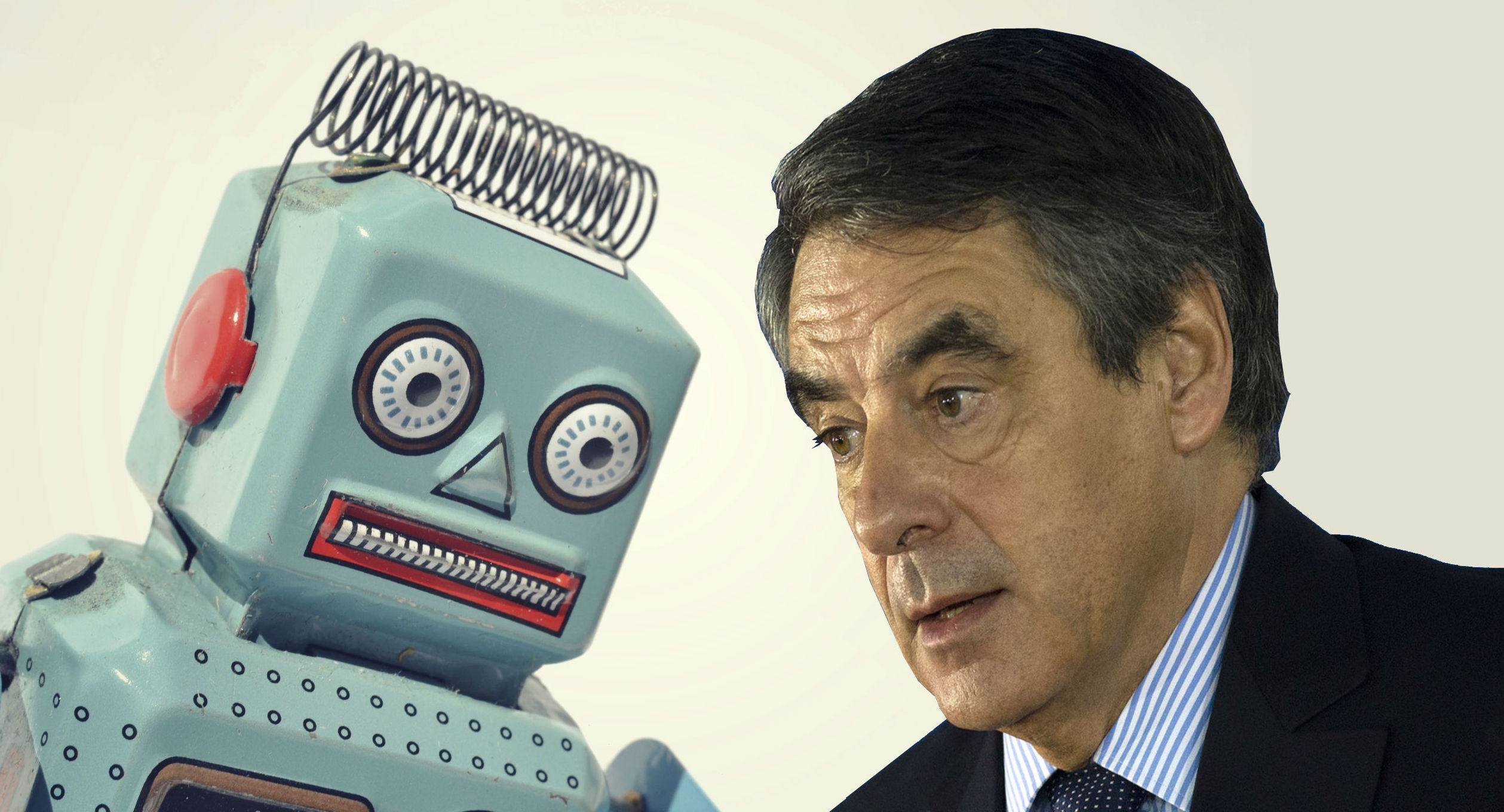

Ni bots, ni e-militants : François Fillon et l’exploitation des travailleurs du clic

Ce billet a été publié dans L’Obs / Rue89 le 3 février 2017. Dans le sillage du PenelopeGate, l’affaire des… read more Ni bots, ni e-militants : François Fillon et l’exploitation des travailleurs du clic

[Vidéo] Grand entretien Mediapart : l’impact des fermes à clic sur les élections (17 déc. 2016)

J’ai rendu visite à la rédaction de Mediapart pour une interview vidéo sur “fake news”, algorithmes et tâcherons du clic…. read more [Vidéo] Grand entretien Mediapart : l’impact des fermes à clic sur les élections (17 déc. 2016)

Bulles de filtres, spirales de silence, algorithmes et politique (NextINpact, 23 nov. 2016)

(Article paru sur NextINpact, 23 novembre 2016) Élection de Trump : influence ou innocence, le rôle de Facebook en questions… read more Bulles de filtres, spirales de silence, algorithmes et politique (NextINpact, 23 nov. 2016)

Economie et politique des plateformes numériques : le programme de mon séminaire #ecnEHESS 2016-17

FINALLY ! Pour la neuvième année consécutive, mon séminaire Étudier les cultures du numérique : approches théoriques et empiriques (#ecnEHESS)… read more Economie et politique des plateformes numériques : le programme de mon séminaire #ecnEHESS 2016-17

[Podcast] Discorde et réveil du politique en ligne (France Culture Plus, 27 mai 2013)

Podcast de l’émission #Politique : Citoyens connectés, de France Culture Plus, webmédia étudiant de France Culture. Le journaliste Christophe Payet… read more [Podcast] Discorde et réveil du politique en ligne (France Culture Plus, 27 mai 2013)

[Podcast] Vers la dictature du trollétariat ? (France Culture Plus, 25 févr. 2013)

Podcast de l’émission #Politique – Citoyens connectés, de France Culture Plus, webmédia étudiant de France Culture. Le journaliste Christophe Payet… read more [Podcast] Vers la dictature du trollétariat ? (France Culture Plus, 25 févr. 2013)

Etude sur la censure des médias sociaux et les émeutes : la presse internationale en parle

Le sujet est plus que jamais d’actualité : à l’occasion des Jeux Olympiques de Londres, les autorités britanniques redoutes des nouvelles explosions de violence comparables aux émeutes qui ont secoué l’Angleterre l’année dernière. L’étude d’Antonio Casilli et Paola Tubaro sur la censure du Web en cas de violence civile, initialement publiée en 2011 sous forme de blog, vient de paraître dans le numéro 115 de la revue Bulletin of Sociological Methodology sous le titre “Social Media Censorship in Times of Political Unrest – A Social Simulation Experiment with the UK Riots”…

Antonio Casilli et Paola Tubaro : une étude contre la censure d'Internet (Owni.fr, 19 août 2011)

Le site web Owni.fr propose une contribution signée par Paola Tubaro (Université de Greenwich, R-U) et Antonio A. Casilli, auteur de Les liaisons numériques. Vers une nouvelle sociabilité ? (Ed. du Seuil). L’article, initialement paru en anglais sur les blogs des auteurs (Bodyspacesociety et Paola Tubaro’s Blog), présente les résultats de leur récente étude portant sur l’impact de la censure des réseaux sociaux prônée par les autorités britanniques pour contrôler les émeutes…

![[Vidéo] Grand entretien Mediapart : l’impact des fermes à clic sur les élections (17 déc. 2016)](https://www.casilli.fr/wp-content/uploads/2016/12/debat-37-illustr01-bis.jpeg)