Tag: micro-work

Who trains the data for Artificial Intelligence in Brazil? New co-authored report

I am thrilled to announce the release of our newest report, Microwork in Brazil. Who are the workers behind artificial… read more Who trains the data for Artificial Intelligence in Brazil? New co-authored report

Artificial intelligence doesn’t destroy jobs, it precarizes them (op-ed Domani, March 24, 2023)

Today, the Italian newspaper Domani published an op-ed that I penned in the wake of the publication of the study… read more Artificial intelligence doesn’t destroy jobs, it precarizes them (op-ed Domani, March 24, 2023)

[Video] Entrevista al programa “30 minuts” (TV3 Catalunya, 22 nov. 2019)

M’han entrevistat pel programa “30 minuts” (televisió Catalana TV3), sobre el treball de plataformes, el micro-treball i l’economia freelance. El… read more [Video] Entrevista al programa “30 minuts” (TV3 Catalunya, 22 nov. 2019)

Interviewé dans l’enquête Mediapart sur assistants vocaux, digital labor et privacy (31 août 2019)

Le site d’information et d’enquête Mediapart publie les révélations depuis l’usine à “intelligence artificielle artificielle” de Siri, signées Jerome Hourdeaux…. read more Interviewé dans l’enquête Mediapart sur assistants vocaux, digital labor et privacy (31 août 2019)

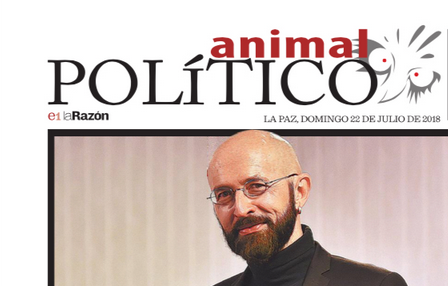

“Las desigualdades del microtrabajo siguen las tensiones del colonialismo” (entrevista La Razon, Bolivia, 22 julio 2018)

Entrevista publicada en Animal Político, suplemento del diario boliviano La Razón. Antonio Casilli: Trabajador digital, el ‘invisible’ Interactuar en internet… read more “Las desigualdades del microtrabajo siguen las tensiones del colonialismo” (entrevista La Razon, Bolivia, 22 julio 2018)

![[Video] Trabajo, conocimiento y vigilancia (La Paz, Bolivia, 11 julio 2018)](https://www.casilli.fr/wp-content/uploads/2018/07/LaPazVicepresidencia.png)

[Video] Trabajo, conocimiento y vigilancia (La Paz, Bolivia, 11 julio 2018)

Presentación de mi libro Trabajo, conocimiento y vigilancia: 5 ensayos sobre tecnología, una antología de mis artículos, originalmente publicados en… read more [Video] Trabajo, conocimiento y vigilancia (La Paz, Bolivia, 11 julio 2018)

We need a political subject capable to think an alternative to digital labor (interview Green European Journal, vol. 17, 2018)

[Update: this interview has been translated in portuguese by Priscila Pedrosa] An interview with Yours Truly and political activist Lorenzo… read more We need a political subject capable to think an alternative to digital labor (interview Green European Journal, vol. 17, 2018)

M, le maudit chatbot (ou, de l’impossibilité de l’automation complète au lendemain de l’échec de l’assistant virtuel de Facebook)

L’année 2018 commence fort chez Zuckerberg. Facebook a décidé de mettre fin à l’expérience de son assistant virtuel, M. Par… read more M, le maudit chatbot (ou, de l’impossibilité de l’automation complète au lendemain de l’échec de l’assistant virtuel de Facebook)

Micro-lavoratori di tutto il mondo… (Rassegna Sindacale, Italia, 17 sett. 2017)

Riassunto della mia lectio magistralis alle Giornate del Lavoro della CGIL. Qui il video del mio intervento. Nel mondo… read more Micro-lavoratori di tutto il mondo… (Rassegna Sindacale, Italia, 17 sett. 2017)

![[Video] Entrevista al programa “30 minuts” (TV3 Catalunya, 22 nov. 2019)](https://www.casilli.fr/wp-content/uploads/2019/12/30-minuts.png)