Month: September 2017

Micro-lavoratori di tutto il mondo… (Rassegna Sindacale, Italia, 17 sett. 2017)

Riassunto della mia lectio magistralis alle Giornate del Lavoro della CGIL. Qui il video del mio intervento. Nel mondo… read more Micro-lavoratori di tutto il mondo… (Rassegna Sindacale, Italia, 17 sett. 2017)

![[Video] Micro-lavoratori, sindacati e intelligenze artificiali (Lecce, Italia, 17 sett. 2017)](https://www.casilli.fr/wp-content/uploads/2017/09/Casilli_CGIL2017.jpg)

[Video] Micro-lavoratori, sindacati e intelligenze artificiali (Lecce, Italia, 17 sett. 2017)

Il 17 settembre 2017, ho presentato una lectio magistralis nel contesto delle Giornate del Lavoro della CGIL (Lecce, Italia). Il… read more [Video] Micro-lavoratori, sindacati e intelligenze artificiali (Lecce, Italia, 17 sett. 2017)

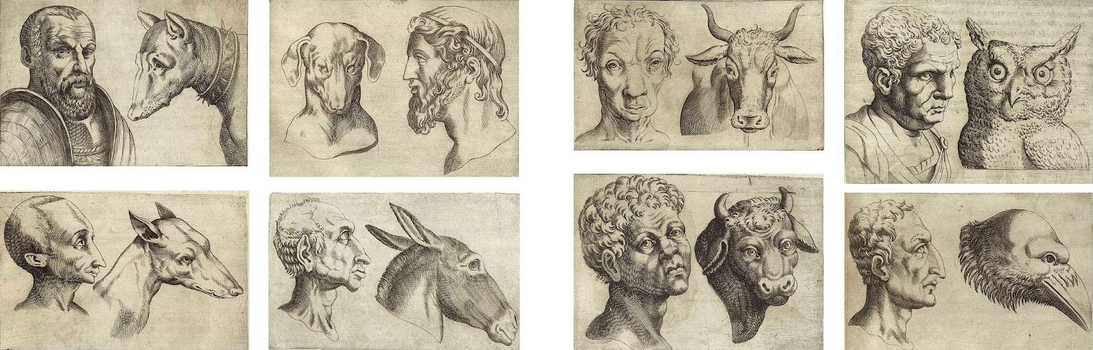

Une intelligence artificielle révèle les préjugés anti-LGBT (et anti-plein d’autres gens) des chercheurs de Stanford

[UPDATE : Ce billet a été repris par le magazine de technologie et société Usbek&Rica. Il a été cité dans… read more Une intelligence artificielle révèle les préjugés anti-LGBT (et anti-plein d’autres gens) des chercheurs de Stanford

Dans Le Monde (02 sept. 2017)

Non, Google ne dit pas tout de nous Nos requêtes sur le moteur de recherche révèleraient nos secrets les mieux… read more Dans Le Monde (02 sept. 2017)